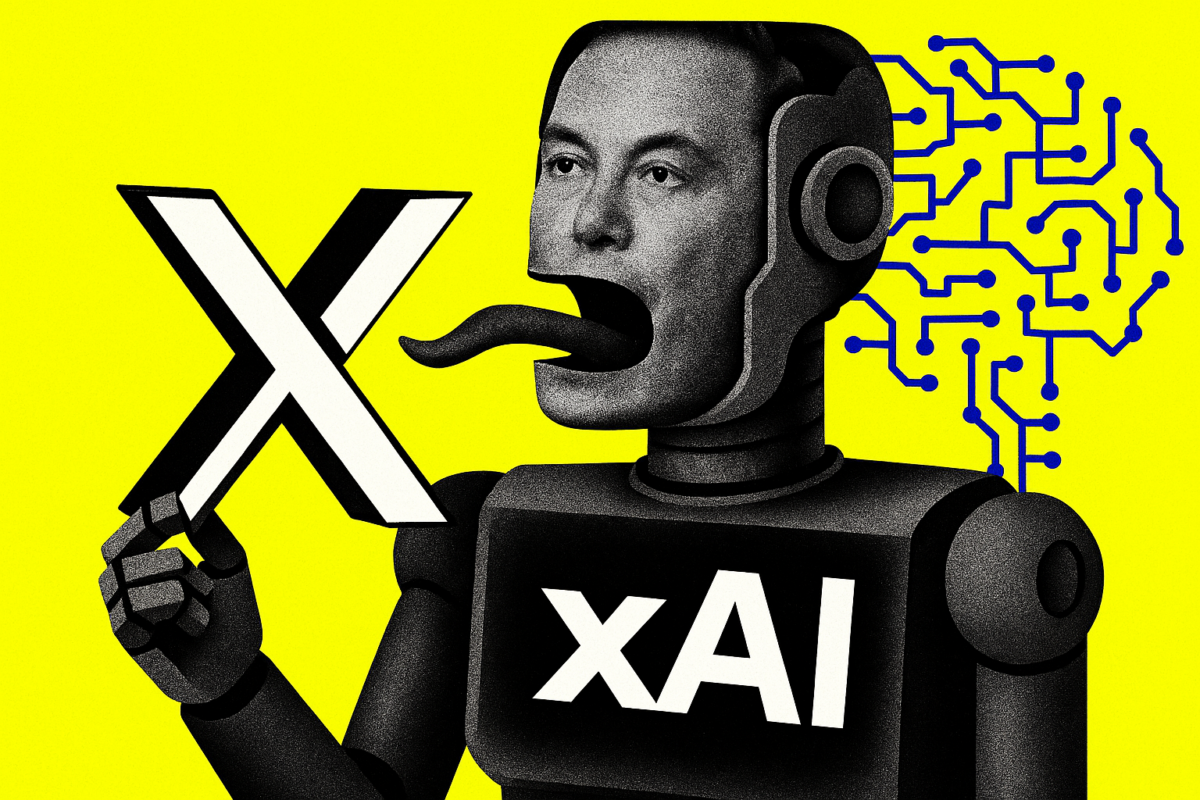

X (Ex-Twitter) Vai Usar IA em Notas da Comunidade: Ajuda ou Confusão?

E aí, meu povo da tecnologia e do mundo real! Notícia que pipocou e merece nossa atenção: o X, aquele lugar que o Musk vive mudando, tá querendo colocar inteligência artificial pra gerar aquelas famosas Notas da Comunidade. Estava lendo num artigo do site The Decoder sobre esse movimento, e achei interessante trazer pra cá.

O que são as Notas da Comunidade, pra começo de conversa?

Pra quem não tá ligado, as Notas da Comunidade (Community Notes) são uma tentativa do X de combater a desinformação. Basicamente, são anotações feitas por usuários que aparecem embaixo de posts pra dar contexto ou corrigir informações que não batem muito com a realidade. É como se fosse uma nota de rodapé coletiva pra dizer "olha, isso aqui não é bem assim" ou "mais informações sobre o assunto estão aqui".

E onde a IA entra nisso?

A ideia agora é usar a IA pra *rascunhar* essas notas. Imagina assim: ao invés de um humano começar do zero, a IA já dá um pontapé inicial, escreve uma sugestão baseada no post e em outras informações. O plano é lançar isso ainda este mês.

Na minha visão, isso tem um lado bom e um lado que acende uma luz amarela. O lado bom é a escala. A quantidade de posts que precisam de contexto ou correção é gigantesca. Uma IA pode processar muito mais rápido e sugerir rascunhos numa velocidade que nenhum exército de humanos conseguiria. Isso tem potencial pra tornar o sistema de notas mais ágil e cobrir mais terreno.

Mas aí vem a luz amarela: a confiança na IA. A notícia diz que, por enquanto, revisores humanos ainda terão a palavra final. A nota só vai pro ar se for considerada útil por usuários com diferentes pontos de vista. **Isso é CRUCIAL.** Em Deus nós confiamos, mas pra confiar numa nota gerada por IA sobre um assunto polêmico, meu amigo, me tragam os dados de quem revisou e como o sistema de votação garante que não vira bagunça.

O futuro (e a bagunça potencial)

E o que mais me chamou a atenção no artigo do The Decoder foi a parte de que, no futuro, até desenvolvedores externos vão poder submeter seus próprios "agentes de IA" pra gerar essas notas. Isso, sim, é um salto pra uma piscina que a gente não sabe se tem água. Abrir pra IAs externas, sem controle direto sobre como foram treinadas ou quais vieses podem ter, adiciona uma camada de complexidade e risco gigante. A validação humana e o sistema de votação terão que ser à prova de falhas (e sabemos que nada é).

Essa discussão sobre como a IA pode ajudar (ou atrapalhar) na checagem de fatos, na moderação e na curadoria de conteúdo é fundamental hoje em dia. É exatamente o tipo de coisa que a gente vive debatendo, sobre os desafios práticos de usar a IA em cenários onde a informação incorreta pode causar estrago.

Aliás, se você quiser trocar ideia sobre esses desafios práticos da IA, as soluções que funcionam no mundo real e como aplicar isso sem cair nas promessas vazias, clica no link pra entrar em contato e entre na comunidade IA Overflow. A gente discute Vertical AI, automação, dados e muito mais, sempre com pé no chão.

Conclusão: Um passo (cauteloso) para frente?

No fim das contas, usar IA pra rascunhar notas de comunidade é um movimento que faz sentido pela necessidade de escala. É um exemplo clássico de como a IA pode ser uma ferramenta poderosa para aumentar a eficiência. No entanto, a dependência do filtro humano e a incerteza de abrir pra IAs externas exigem que a gente observe isso com realismo e atenção aos detalhes. A tecnologia avança rápido, mas a responsabilidade sobre a informação continua sendo um desafio complexo que nenhuma IA sozinha vai resolver.